内心独白通过语言模型规划的具体推理

发布日期:2022-07-27 17:14:50 来源: 编辑:

大型语言模型(LLM)拥有丰富的关于世界的内化知识,并且能够进行一定程度的演绎并回答需要推理和推理的问题。因此,arXiv.org上最近的一篇论文提出使用语言模型作为具体任务的交互式问题解决器,例如机器人操作。

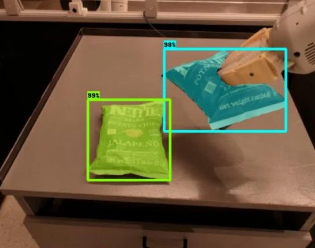

研究人员将多个感知模型与机器人正在与之合作的人类用户提供的反馈结合起来。为了执行用户给出的命令,从一组预先训练的机器人操作技能及其文本描述中选择动作。

InnerMonologue系统的创建是为了在共享语言提示中将这些组件链接在一起。因此,该系统可以在仿真中以及在现实世界的机器人平台上完成复杂、长期和看不见的任务。

最近的工作展示了如何将大型语言模型(LLM)的推理能力应用于自然语言处理之外的领域,例如机器人的规划和交互。这些体现的问题需要智能体理解世界的许多语义方面:可用的技能库、这些技能如何影响世界,以及世界的变化如何映射回语言。在具体环境中进行规划的LLM不仅需要考虑要做什么技能,还要考虑如何以及何时去做——答案会随着时间的推移而变化,以响应代理人自己的选择。在这项工作中,我们调查了在这种具体情境中使用的LLM在多大程度上可以推理通过自然语言提供的反馈来源,而无需任何额外的培训。我们建议通过利用环境反馈,LLM能够形成内心独白,使他们能够在机器人控制场景中进行更丰富的处理和计划。我们调查各种反馈来源,例如成功检测、场景描述和人机交互。我们发现闭环语言反馈显着提高了三个领域的高级指令完成度,包括模拟和真实的桌面重新排列任务以及现实世界厨房环境中的长视野移动操作任务。

标签: