人工智能如何解释其决策

可以训练人工智能(AI)识别组织图像是否包含肿瘤。然而,直到现在,它究竟是如何做出决定的仍然是一个谜。来自波鸿鲁尔大学蛋白质诊断研究中心(PRODI)的一个团队正在开发一种新方法,该方法将使AI的决策透明并因此值得信赖。由AxelMosig教授领导的研究人员在医学图像分析杂志上描述了这种方法。

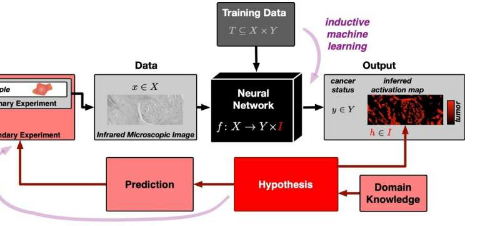

在这项研究中,生物信息学科学家AxelMosig与病理学研究所所长AndreaTannapfel教授、鲁尔大学圣约瑟夫医院的肿瘤学家AnkeReinacher-Schick教授以及生物物理学家和PRODI创始主任KlausGerwert教授合作。该小组开发了一种神经网络,即人工智能,可以对组织样本是否包含肿瘤进行分类。为此,他们为人工智能提供了大量的显微组织图像,其中一些包含肿瘤,而另一些则没有肿瘤。

AxelMosig解释说:“神经网络最初是一个黑匣子:尚不清楚网络从训练数据中学习了哪些识别特征。”与人类专家不同,他们缺乏解释自己决定的能力。“然而,特别是对于医疗应用,人工智能能够解释并因此值得信赖是很重要的,”参与这项研究的生物信息学科学家大卫舒马赫补充道。

人工智能基于可证伪的假设

因此,波鸿团队的可解释人工智能基于科学已知的唯一一种有意义的陈述:基于可证伪的假设。如果假设是错误的,则必须通过实验证明这一事实。人工智能通常遵循归纳推理的原则:使用具体的观察,即训练数据,人工智能创建一个通用模型,并在此基础上评估所有进一步的观察。

250年前哲学家大卫休谟已经描述了潜在的问题,并且可以很容易地说明:无论我们观察到多少白天鹅,我们都无法从这些数据中得出结论,所有天鹅都是白色的,而且根本不存在黑天鹅。因此,科学利用了所谓的演绎逻辑。在这种方法中,一般假设是起点。例如,当发现一只黑天鹅时,所有天鹅都是白色的假设就被证伪了。

激活图显示检测到肿瘤的位置

“乍一看,归纳人工智能和演绎科学方法似乎几乎不相容,”同样为这项研究做出贡献的物理学家斯蒂芬妮·舍尔纳(StephanieSchörner)说。但研究人员找到了一种方法。他们的新型神经网络不仅提供了组织样本是否包含肿瘤或无肿瘤的分类,它还生成了微观组织图像的激活图。

激活图基于一个可证伪的假设,即源自神经网络的激活与样本中的肿瘤区域完全对应。位点特异性分子方法可用于检验这一假设。

“由于PRODI的跨学科结构,我们拥有将基于假设的方法纳入未来值得信赖的生物标志物AI开发的最佳先决条件,例如能够区分某些与治疗相关的肿瘤亚型,”Axel总结道莫西格。

标签: